Корпорація Google анонсувала Gemma 4 — нову родину відкритих ШІ-моделей для поглиблених роздумів та агентських процесів.

Ми щойно випустили Gemma 4 — наші найрозумніші відкриті моделі на сьогодні.

Створені на тій самій науково-дослідній основі світового рівня, що й Gemini 3, Gemma 4 приносять новаторський інтелект безпосередньо на ваше обладнання для поглиблених роздумів та агентних процесів.

Випущено під комерційною… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) April 2, 2026

«Gemma 4 — наші найрозумніші відкриті моделі на сьогодні. Вони надають безпрецедентний рівень інтелекту на параметр», — зазначено в повідомленні.

З моменту запуску першого покоління розробники завантажили Gemma понад 400 млн разів, створивши більше ніж 100 000 варіантів моделей в екосистемі Gemmaverse. Остання ітерація збудована на основі тих самих наукових досліджень і технологій, що й чат-бот Gemini 3.

Різні розміри

Сімейство нейронних мереж Gemma 4 містить чотири версії: Effective 2B (E2B), Effective 4B (E4B), 26B Mixture of Experts (MoE) і 31B Dense.

Компактні E2B та E4B на 2,3 млрд та 4,5 млрд активних параметрів роблять акцент на мультимодальності, малій затримці та простій інтеграції. Їх можливо запустити на смартфоні або звичайному лептопі.

Для функціонування 26B MoE та флагманської 31B (на 26 млрд та 31 млрд параметрів) потрібен графічний прискорювач рівня Nvidia H100 з 80 ГБ пам’яті. Дані моделі оптимізовані для дослідників і девелоперів.

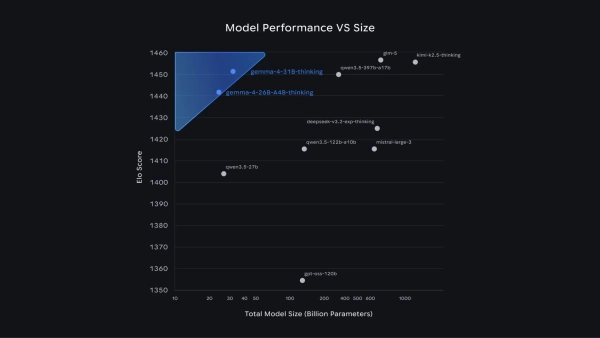

Більш потужні версії показують високі результати в бенчмарках. У глобальному рейтингу відкритих текстових моделей Arena AI флагманська 31B посідає третю позицію, а 26B — шосту. Згідно зі словами девелоперів, нова лінійка перевершує аналоги від конкурентів, які в 20 разів більші.

Джерело: Google.

Ключові можливості

Одна з основних переваг Gemma 4 — розвинені здатності до роздумів. Моделі здатні вибудовувати комплексну логіку та планувати задачі у декілька кроків. Вони демонструють значний прогрес у математичних бенчмарках і точно дотримуються інструкцій.

Серед інших особливостей:

- агентські робочі процеси — вбудована підтримка виклику функцій, структурованого виводу у форматі JSON і системних інструкцій дозволяє створювати автономних асистентів, які взаємодіють з інструментами та API;

- генерація коду — Gemma 4 забезпечує якісне написання коду в офлайн-режимі, перетворюючи робочу станцію на локального ШІ-помічника;

- зір та аудіо — усі моделі обробляють відео та зображення зі змінною роздільною здатністю, розпізнають текст та аналізують діаграми. E2B та E4B також підтримують розпізнавання та розуміння мови;

- розширене контекстне вікно — компактні версії підтримують 128 000 токенів, а більші — до 256 000. Цього досить для обробки цілих репозиторіїв або великих документів в межах одного запиту;

- багатомовність — сімейство моделей може працювати з більш ніж зі 140 мовами.

Gemma 4 вже доступна у Google AI Studio та Google AI Edge Gallery. Інтеграцію також підтримують відомі сторонні інструменти та фреймворки, у тому числі Hugging Face, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM та LM Studio.

Моделі можна налаштовувати через Google Colab, Vertex AI або на локальних відеокартах. Для продакшену доступне розгортання на Google Cloud, включно з Cloud Run, GKE та Sovereign Cloud.

Нагадаємо, на початку квітня Google анонсувала нову модель ШІ для генерації відео — Veo 3.1 Lite.