Фірма Anthropic представила Claude Opus 4.7 — найбільш продуктивну на сьогодні версію з серії Opus.

Зустрічайте Claude Opus 4.7 — нашу найздібнішу модель Opus на даний момент.

Вона уважніше виконує тривалі завдання, більш точно слідує вказівкам і оцінює свої відповіді перед тим, як їх відправляти.

Можете довіряти їй найскладнішу діяльність з мінімальним контролем. pic.twitter.com/PtlRdpQcG5

— Claude (@claudeai) April 16, 2026

Нова ітерація доступна всім платним клієнтам Claude і в API — $5 за 1 мільйон вхідних токенів, $25 — за 1 мільйон вихідних.

Основні вдосконалення

Opus 4.7 найкраще демонструє себе у непростих проєктах. Користувачі покладаються на неї у тому, що раніше вимагало ретельного нагляду, зауважили творці.

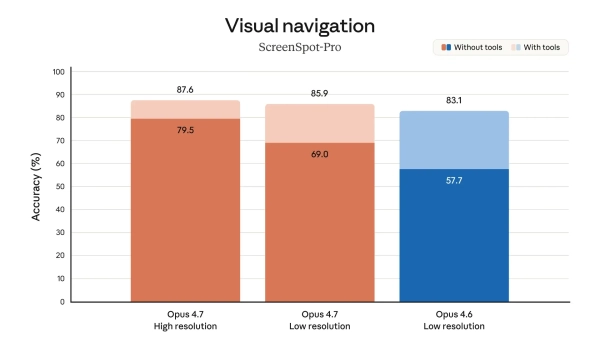

У програмуванні агентів модель перевершила попередницю на 10%, в аналізі візуальної інформації — на 13%. За іншими показниками зростання більш помірне.

Модель отримала значно розширені візуальні можливості: опрацьовує зображення до 2576 пікселів по довгому краю (приблизно 3,75 Мп) — більше ніж втричі перевищує можливості попередніх ітерацій Claude.

Джерело: Anthropic.

Opus 4.7 чіткіше дотримується настанов. Промпти, розроблені для давніх моделей, можуть видавати непередбачувані результати: вони по-різному трактували вказівки, тоді як нова версія сприймає їх дослівно. Радимо переробити запити.

До того ж, остання Claude навчилася фіксувати відомості між сесіями — утримує замітки у файлах і може застосовувати їх у кожній наступній бесіді.

Anthropic додала в Opus 4.7 новий ступінь зусиль xhigh («надзвичайно високий») — між high («високий») і max («максимальний»). Він дає змогу більш точно регулювати баланс між глибиною аналізу та оперативністю відповіді.

У Claude Code ступінь зусиль за замовчуванням підвищено до xhigh для всіх тарифних планів.

Інші оновлення:

- Task budgets (публічна бета API) — управління споживанням токенів;

- /ultrareview — окрема сесія ревізії коду в Claude Code;

- режим auto для користувачів Max — Claude сама приймає рішення.

Обмеження кіберможливостей

Opus 4.7 слабша за Mythos Preview у кібербезпеці. Anthropic навмисне знизила ці можливості під час навчання. Модель має вбудований захист, який блокує несанкціоновані та ризиковані запити.

«Те, що ми отримаємо з реальної реалізації цих охоронних механізмів, допоможе нам рухатися до нашої кінцевої мети — широкого розповсюдження моделей класу Mythos», — відзначила команда стартапу.

Фахівцям з безпеки, які хочуть застосовувати Opus 4.7 у законних цілях (вивчення вразливостей, пентести), в Anthropic запропонували долучитися до нової програми Cyber Verification.

Для клієнтів обмеження перетворилися на проблему. Деякі клієнти нарікають, що модель відмовляється писати код, оскільки «бачить шкідливе ПЗ у кожному запиті».

Вона підозрює, що все є шкідливим ПЗ, і все одно відмовляється генерувати код після підтвердження, що шкідливого ПЗ немає pic.twitter.com/YXpaoNV8YG

— Hanh Nguyen (@fashiongiik) April 16, 2026

Реакція OpenAI

Компанія OpenAI анонсувала «важливе оновлення» Codex, яке наразі доступне лише на macOS.

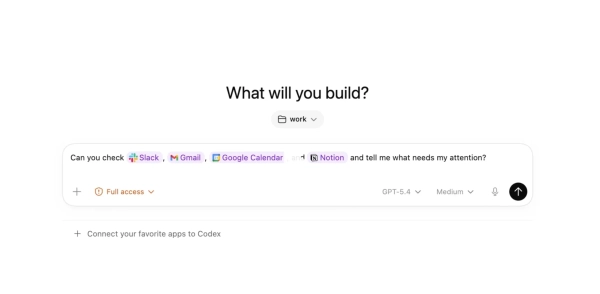

Codex для (практично) всього.

Зараз він може використовувати застосунки на вашому Mac, з’єднуватися з більшою кількістю інструментів, конструювати образи, вчитися на минулих діях, запам’ятовувати, як вам зручно працювати, і перебирати на себе поточні та повторювані завдання. pic.twitter.com/UEEsYBDYfo

— OpenAI (@OpenAI) April 16, 2026

Нова ітерація вміє співпрацювати з застосунками на комп’ютері клієнта: бачити монітор, натискати та друкувати власним курсором. На Mac підтримується одночасна діяльність декількох агентів без перешкод для іншого софту.

Інтегрований браузер, плагіни та життєвий цикл розробки

Codex обладнаний вбудованим браузером: сторінки можна коментувати безпосередньо, надаючи агенту точні інструкції. Це корисно для фронтенд- та ігрової розробки.

З можливістю взаємодії з комп’ютером на macOS Codex тепер може використовувати будь-який застосунок, бачачи, натискаючи та вводячи текст власним курсором.

Він працює у фоновому режимі, не займаючи ваш комп’ютер, виконуючи завдання на зразок ітерацій фронтенду, тестування застосунків чи будь-яких робочих процесів без наявного API. pic.twitter.com/iO9iubLZX9

— OpenAI (@OpenAI) April 16, 2026

Творці мають намір розширити управління браузером за межі локального середовища.

Також Codex отримав підтримку gpt-image-1.5 для генерації та ітерацій зображень. Разом зі знімками екрана та кодом це дає змогу створювати візуальні концепти, фронтенд-дизайн, макети та ігри в єдиному інтерфейсі.

Тепер ви можете генерувати та ітерувати образи за допомогою gpt-image-1.5 у Codex, створюючи фронтенд-дизайни, макети, ігрові ресурси тощо, не виходячи зі свого робочого процесу.

Використання входить до вашого акаунта ChatGPT, жодного API-ключа не потрібно. pic.twitter.com/ay17I3Nxoa

— OpenAI (@OpenAI) April 16, 2026

OpenAI випустила понад 90 додаткових плагінів, що поєднують навички, інтеграції із застосунками та MCP-сервери. Серед них — Atlassian Rovo для взаємодії з JIRA, CircleCI, CodeRabbit, GitLab Issues, Microsoft Suite, Neon by Databricks, Remotion, Render і Superpowers.

У Codex додали підтримку коментарів GitHub, декількох вкладок термінала та підключення до віддалених devbox через SSH (в альфа-версії).

Клієнти можуть відкривати файли просто в бічній панелі з розширеним переглядом PDF, таблиць, слайдів і документів, а також користуватися новою панеллю зведення для відстеження планів агента, джерел та артефактів.

Пам’ять і планування

Codex навчився планувати наступну діяльність і автоматично відновлювати виконання довготривалих завдань — потенційно на дні чи тижні. Групи застосовують автоматизацію для різних завдань: від запитів на ревізію коду до відстеження задач у Slack, Gmail і Notion.

Джерело: OpenAI.

Розробники вдосконалили пам’ять помічника. Codex навчився утримувати корисний контекст із попередніх діалогів — персональні уподобання та виправлення.

Модель також активно пропонує потрібні дії, продовжуючи роботу з тієї точки, де зупинився клієнт. Наприклад, агент може знайти відкриті коментарі в Google Docs, витягти контекст зі Slack, Notion і кодової бази, а потім видати пріоритетний список дій.

Нова модель GPT

Додатково OpenAI представила модель ШІ GPT‑Rosalind для прискорення створення ліків.

Зустрічайте GPT‑Rosalind — нашу передову аналітичну модель, створену для забезпечення підтримки досліджень у біології, пошуку ліків і трансляційній медицині. pic.twitter.com/PubLU0FkSv

— OpenAI (@OpenAI) April 16, 2026

Її названо на честь англійської біофізикині Розалінд Франклін, чиї дослідження допомогли виявити структуру ДНК і заклали підвалини сучасної молекулярної біології.

Розробники відзначили, що в США на створення нового препарату йде в середньому 10–15 років. Доля препарату значною мірою вирішується на початкових стадіях досліджень. Найбільші складнощі пов’язані з опрацюванням великих масивів наукових публікацій і вузькоспеціалізованих баз даних.

Мета GPT‑Rosalind — бути асистентом біолога: резюмувати наукові тексти, формулювати гіпотези, розробляти плани експериментів і обробляти інформацію. Модель особливо сильна в проєктах, пов’язаних із білками, генами та подібними біологічними об’єктами.

На бенчмарку BixBench (реальний біоінформатичний аналіз) GPT‑Rosalind продемонструвала один із найкращих результатів серед моделей з оприлюдненими даними.

На LABBench2 рішення обійшло GPT‑5.4 у шести з 11 проєктів. Найбільший відрив — у CloningQA, де потрібно проєктувати ДНК і ферменти для протоколів молекулярного клонування.

Додатково OpenAI виклала безкоштовний плагін Life Sciences для Codex на GitHub. Він доступний усім клієнтам і дає змогу під’єднати ШІ до більш ніж 50 публічних наукових баз даних і спеціалізованих інструментів.

Нагадаємо, 16 квітня компанія Google випустила Gemini 3.1 Flash TTS — оновлену модель синтезу мовлення на основі покоління Gemini 3.