OpenAI збирається внести корективи в угоду з Міністерством оборони на тлі шквалу критики та масового переходу користувачів на Anthropic. Про це заявив керівник ШІ-стартапу Сем Альтман.

Here is re-post of an internal post:

We have been working with the DoW to make some additions in our agreement to make our principles very clear.

1. We are going to amend our deal to add this language, in addition to everything else:

“• Consistent with applicable laws,…

— Sam Altman (@sama) March 3, 2026

«Одна річ, яку я зробив помилково: нам не варто було так швидко укладати угоду. Проблеми досить складні й вимагають відкритої комунікації. Ми щиро намагалися зменшити напруженість і запобігти значно гіршому результату, але, думаю, це виглядало як використання можливості та легковажно», — написав він.

OpenAI підписала договір із Міністерством оборони США 28 лютого. За декілька годин до цього очільник держави Дональд Трамп розпорядився федеральним відомствам відмовитися від продуктів Anthropic.

Причиною стала заява директора проєкту Даріо Амодея, котрий відкрито заборонив застосовувати нейромережі розробника в масовому спостереженні та виробництві самостійної зброї.

Нові умови

У оновленій версії договору OpenAI додала пункт, який забороняє «навмисне застосування штучного інтелекту» для стеження за громадянами Сполучених Штатів. Окремо зазначено, що обмеження розповсюджуються на придбання або використання комерційних баз особистих даних.

Міністерство оборони США також підтвердило: інструменти компанії не будуть застосовуватися розвідувальними службами, зокрема АНБ. Будь-які поставки подібним відомствам вимагатимуть додаткової згоди.

«Надзвичайно важливо захищати громадянські права американців. На цьому було зосереджено стільки уваги, що ми захотіли прояснити цей момент особливо чітко», — пояснив керівник OpenAI.

Він наголосив, що в регулюванні розвитком ШІ важливо дотримуватися демократичних процедур. Зі слів Альтмана, жодна приватна фірма не повинна вирішувати долю світу.

Голова розробника ChatGPT закликав Пентагон не включати Anthropic до списку загроз ланцюгам постачання та запропонувати конкурентам ті ж умови, що й OpenAI.

«Я думаю, що справжні небезпеки для світу ще попереду. Я спробував уявити себе на місці людини, яка прокинеться наступного дня після нападу на США або появи нової біологічної зброї, якій ми могли б допомогти запобігти», — підсумував Альтман.

Бойкот ChatGPT

На тлі новини про договір із Пентагоном американські користувачі почали активно відмовлятися від ChatGPT, повідомляє TechCrunch. За добу 1 березня кількість видалень застосунку збільшилася на 295%, підрахували в Sensor Tower.

Звичайний щоденний показник деінсталяцій за останні 30 днів становив 9%, уточнили аналітики.

Динаміка нових завантажень змінилася зниженням: одразу після договору завантаження ChatGPT впали на 13%, а за день — ще на 5%. Оцінка застосунку також знизилася: число «п’ятірок» зменшилося вдвічі, а кількість негативних відгуків зросла у 8,5 раза в першу ж ніч і подвоїлася 2 березня.

ChatGPT is getting COOKED on the iOS App Store reviews and I think it’s deserved. pic.twitter.com/QaCZx7iHrC

— Not Greg (@dogecoinmillion) March 3, 2026

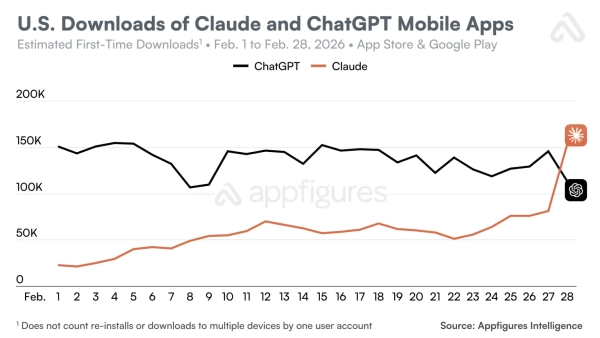

Завантаження Claude від Anthropic зросли на 37% 28 лютого і ще на 51% — 1 березня. Чат-бот вийшов на першу позицію в американському App Store і зберігає лідерство станом на 3 березня.

Інші аналітичні платформи підтвердили тенденцію. В Appfigures повідомили, що щоденні інсталяції Claude у США вперше обійшли ChatGPT: за добу 1 березня показник збільшився на 88%. Застосунок також очолив рейтинги безплатних iPhone-застосунків у Бельгії, Канаді, Німеччині, Люксембурзі, Норвегії та Швейцарії.

Динаміка завантажень мобільних застосунків Claude і ChatGPT у лютому. Джерело: TechCrunch/Appfigures.

У Similarweb підрахували, що за останній тиждень завантаження Claude у США перевищили січневі приблизно у 20 разів. Втім, експерти закликали не робити швидких висновків, припустивши, що на статистику могли вплинути й інші чинники.

Крім відмови від ChatGPT, понад 700 працівників Google і OpenAI також підписали відкритий лист. У документі вони закликали відмовитися від використання ШІ в системах стеження або для виконання бойових завдань без безпосереднього контролю з боку людини.

Нагадаємо, в середині лютого журналісти Bloomberg дізналися про наміри SpaceX створити ПЗ для автоматизованої зброї Пентагону.