Фірма Anthropic звинувачує три китайські AI-стартапи — DeepSeek, Moonshot і MiniMax — у масштабній акції з використання Claude для вдосконалення своїх власних моделей.

Лабораторії з КНР згенерували більше ніж 16 мільйонів взаємодій з чатботом через орієнтовно 24 000 фіктивних акаунтів, порушивши умови користування та регіональні обмеження.

«Ми з високим ступенем переконаності пов’язали кожну акцію з конкретною компанією на основі зіставлення IP-адрес, метаданих запитів, інфраструктурних ознак та підтверджень від партнерів в галузі. Вони націлилися на найунікальніші здібності Claude: агентні розмірковування, застосування інструментів і програмування», — повідомили в Anthropic.

Компанії застосували дистиляцію — навчання менш потужної нейромережі на висновках більш сильної.

Це широко використовуваний і правомірний метод. Провідні AI-лабораторії регулярно дистилюють власні моделі, щоб створювати їх компактніші та дешевші версії для користувачів.

«Однак, вона може застосовуватися і незаконно: конкуренти поліпшують можливості за рахунок чужих LLM за короткий час і витрати у порівнянні з самостійною розробкою», — зазначено у блозі Anthropic.

У компанії підкреслили, що час для реагування на подібну «крадіжку» обмежений, а загроза поширюється за межі однієї компанії чи регіону. Для її усунення необхідні швидкі та скоординовані дії з боку індустрії, регуляторів і світової AI-спільноти.

Чому це ризиковано

В Anthropic роз’яснили ризики такого підходу: незаконно дистильовані моделі не зберігають необхідні захисні механізми — це спричиняє проблеми для національної безпеки.

Американські компанії впроваджують системи, що унеможливлюють використання штучного інтелекту для створення біологічної зброї, зловмисних кібератак та інших небезпечних дій. Створені через незаконну дистиляцію моделі подібних обмежень не отримують.

Закордонні лабораторії можуть інтегрувати незахищені функції у військові й розвідувальні системи, дозволяючи авторитарним урядам використовувати передовий AI для кібератак, дезінформації та масового стеження, додали в компанії.

Методи протидії

Експерти Anthropic підтримали експортні обмеження для підтримки лідерства США в AI. На їхню думку, дистиляційні атаки руйнують ці заходи, дозволяючи закордонним лабораторіям зменшувати технологічний розрив.

«Без прозорості таких атак швидкий прогрес китайських лабораторій хибно трактується як доказ неефективності експортних обмежень. Фактично їхні досягнення значною мірою залежать від вилучення функцій американських моделей, а розширення такого підходу потребує доступу до передових чипів», — йдеться у блозі компанії.

Anthropic назвала власні методи протидії:

- поліпшення системи виявлення патернів дистиляції;

- обмін технічними індикаторами з іншими лабораторіями та хмарними провайдерами;

- посилення верифікації освітніх та дослідницьких акаунтів;

- застосування контрзаходів, що знижують ефективність незаконної дистиляції.

Це не перше подібне звинувачення. У січні 2025 року незабаром після гучного виходу DeepSeek-R1 компанію запідозрили у викраденні даних в OpenAI.

Продовження протистояння з Пентагоном

CEO Anthropic Даріо Амодей зустрінеться з міністром оборони Пітом Хегсетом у Пентагоні для обговорення способів використання AI-моделей компанії військовими.

Останнім часом між сторонами виникли розбіжності — Anthropic виступає проти використання штучного інтелекту для масового стеження за громадянами США та створення автономної зброї. У Міноборони чітко дали зрозуміти, що мають намір використовувати LLM «для всіх законних сценаріїв» без обмежень.

Справа дійшла до того, що в Пентагоні заявили про можливе припинення угоди з Anthropic.

AI-сканер вразливостей

Акції провідних публічних компаній у сфері кібербезпеки впали після запуску Anthropic інструменту Claude Code Security — це AI-сканер вразливостей у коді.

На сайті компанії вказано, що новий сервіс «аналізує всю кодову базу на наявність вразливостей, перевіряє кожну знахідку для мінімізації хибних спрацювань і пропонує виправлення».

Claude проводить аналіз «як досвідчений дослідник безпеки»: розуміє контекст, відстежує потоки даних, виявляє вразливості.

За інформацією VentureBeat, Claude Opus 4.6 виявила понад 500 критичних вразливостей, які зберігалися десятиліттями, попри перевірки експертів.

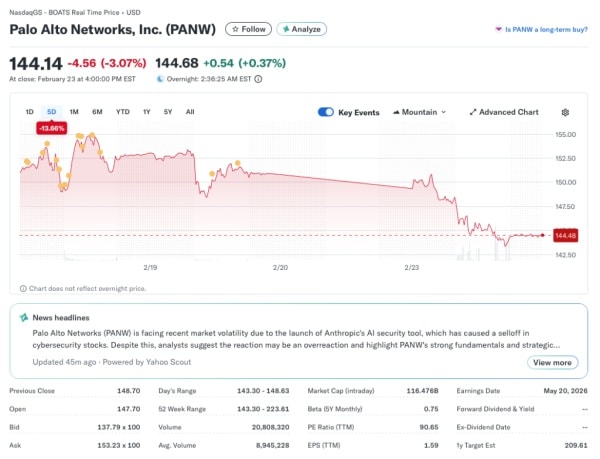

П’ять найбільших за капіталізацією американських публічних компаній у галузі IT-безпеки продемонстрували двозначне зниження котирувань за останні п’ять днів на тлі появи AI-конкурента:

- Palo Alto Networks — -14%;

- CrowdStrike — -18%;

- Fortinet — -12%;

- Cloudflare — -18%;

- Zscaler — -19%.

Графік динаміки акцій Palo Alto Networks. Джерело: Yahoo Finance.

Аналітики Wedbush заявили, що розпродаж паперів пов’язаний з побоюваннями навколо так званого AI Ghost Trade. На їхню думку, реакція ринку помилкова, а Palo Alto, CrowdStrike і Zscale доведуть свою ефективність у 2026 році.

Нагадаємо, у лютому OpenAI спільно з Paradigm представила EVMbench — бенчмарк для оцінки здатності AI-агентів виявляти, виправляти та експлуатувати вразливості в смартконтрактах.