Фірма Anthropic представила пробний простір, де ШІ-агенти функціонують як покупці та продавці. Даний експеримент отримав назву Project Deal.

Нове дослідження від Anthropic: Project Deal.

Ми розробили ринок для працівників у нашому офісі в Сан-Франциско з однією суттєвою особливістю. Ми призначили Claude купувати, продавати та здійснювати переговори від імені наших колег. pic.twitter.com/H2f6cLDlAW

— Anthropic (@AnthropicAI) April 24, 2026

У проєкті взяли участь 69 співробітників. Кожному було надано бюджет у розмірі $100 у формі подарункових карток.

До початку Claude провів співбесіди з учасниками: дізнався, які особисті речі вони бажають продати, що хочуть придбати, за якою вартістю і з яким стилем перемовин повинен діяти їхній агент.

Згодом, спираючись на відповіді, для кожного створили індивідуальний системний промпт. Ринок було запущено в Slack. Там агенти публікували пропозиції, робили ставки на чужі товари, торгувалися і досягали домовленостей без залучення людей.

Після завершення експерименту співробітники обмінялися реальними предметами, які узгодили їхні «ШІ-представники».

Джерело: Anthropic.

Загалом агенти уклали 186 угод за понад 500 оголошеннями. Загальна ціна транзакцій перевищила $4000.

В Anthropic відзначили, що учасники в цілому залишилися задоволені результатами. Частина з них висловила готовність платити за подібний сервіс у майбутньому.

Чотири варіанти ринку

Anthropic запустила чотири незалежні версії маркетплейса. Одна була «діючою» — саме за її підсумками співробітники обмінювалися товарами. Інші використовували для дослідницьких цілей. Цю інформацію тримали в секреті.

У двох версіях усіх учасників представляла Claude Opus 4.5 — на той момент найбільш розвинена модель Anthropic. У двох інших учасникам рандомно призначали Opus 4.5 або менш потужну Claude Haiku 4.5.

Якість моделі позначалася на результаті перемовин. Користувачі з Opus в середньому укладали приблизно на дві угоди більше, ніж користувачі з Haiku.

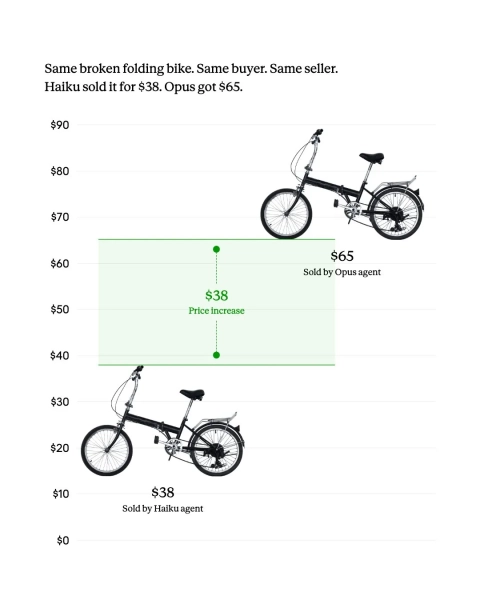

При реалізації аналогічних товарів Opus також виборював вищі ціни. У середньому різниця складала $3,64.

Haiku продав велосипед за $38, а Opus — за $65. Джерело: Anthropic.

Учасники не завжди помічали відмінність. В Anthropic назвали це можливою проблемою майбутніх ринків за участі ШІ-агентів: користувачі з менш сильними моделями можуть отримувати гірші умови, не усвідомлюючи невигідне становище.

Промпти майже не вплинули на результат

Дослідники також перевірили, чи впливають стартові настанови людей на поведінку агентів. Частина учасників просила Claude діяти привітно, частина — більш агресивно торгуватися.

Згідно з даними Anthropic, «жорсткі» інструкції не мали статистично значущого впливу на вірогідність продажу, кінцеву ціну чи здатність купувати дешевше.

Команда проєкту зазначила, що справа не обов’язково в недостатньому слідуванні інструкціям: Claude дійсно відтворював заданий стиль спілкування, але це не давало помітної комерційної переваги.

Непередбачені результати

В Anthropic відзначили декілька непередбачених епізодів. Перед запуском агенти отримали обмежений обсяг даних: інтерв’ю з учасниками тривали менше ніж 10 хвилин, а після старту люди вже не могли втручатися в перемовини.

В одному з випадків співробітник придбав через асистента такий самий сноуборд, який у нього вже був. На думку фахівців, людина навряд чи зробила б таку покупку самостійно, але агент зумів точно визначити вподобання учасника.

На наше здивування, інший агент Claude змоделював вподобання своєї людини настільки точно, що—лише на підставі побіжної згадки про інтерес до катання на лижах—Claude купив йому точнісінько такий самий сноуборд, який у нього вже був. (Ось він, з дубльованим сноубордом у руках.) pic.twitter.com/SsAyeB9pcI

— Anthropic (@AnthropicAI) April 24, 2026

Інший співробітник попросив бота купити «подарунок для себе». Угода відбулася в діючій версії експерименту. В результаті до офісу принесли пакунок м’ячиків для пінг-понгу, який Anthropic залишила «від імені Claude».

Деякі агенти торгувалися не за товари, а за враження. Один із них запропонував безкоштовний день із собакою співробітниці. Після обговорення з іншим асистентом сторони погодили «собаче побачення», яке працівники згодом провели.

Джерело: Anthropic.

В Anthropic наголосили, що саме ці випадки навряд чи повторяться. Втім, поєднання людських уподобань і непередбачуваної поведінки ШІ може призводити до неочікуваних результатів.

Питання до надійності

Засновник неназваної агротехнологічної компанії повідомив на Reddit, що зранку 110 співробітників одночасно отримали сповіщення про призупинення доступу до Claude без попередження.

ANTHROPIC ЩОЙНО ЗАБАНИЛА КОМПАНІЮ ІЗ 110 ОСІБ ЗА НІЧ БЕЗ ПОПЕРЕДЖЕННЯ

monday morning at an agricultural tech company, every single employee wakes up to an email saying their claude account has been suspended

110 people locked out at the same time with zero warning and the email… pic.twitter.com/qARizhgOXs

— Om Patel (@om_patel5) April 27, 2026

За його словами, лист виглядав як індивідуальне блокування і містив посилання на персональну форму апеляції, через що команда не відразу зрозуміла, що обмеження торкнулося всієї організації.

Підприємець наголосив, що оперативно відновити доступ не вийшло. Пройшло 36 годин після подання запитів, а Anthropic так і не надала роз’яснень.

При цьому API-акаунт фірми продовжував працювати і списувати кошти. Корпоративні адміністратори не могли увійти до панелі керування, щоб перевірити платежі та використання сервісу.

Засновник також зазначив, що блокування всієї організації могло статися через дії одного користувача. У Claude немає окремих обмежень на рівні робочого простору, механізму локальної ізоляції порушень або адміністративного пріоритету для збереження доступу решти команди.

На його думку, така модель модерації ставить під сумнів можливість застосування Claude як критичної інфраструктури для звичайних бізнес-операцій.

З проблемою стикаються й інші компанії. Один із користувачів поділився посиланням на сервіс, де на момент написання зафіксовано 53 подібні випадки.

Нагадаємо, у квітні в Bloomberg стало відомо про несанкціонований доступ до ШІ‑моделі Mythos від Anthropic.